C’è anche una firma ticinese

nello studio che porterà al nuovo Centro europeo di ricerca sull’AI

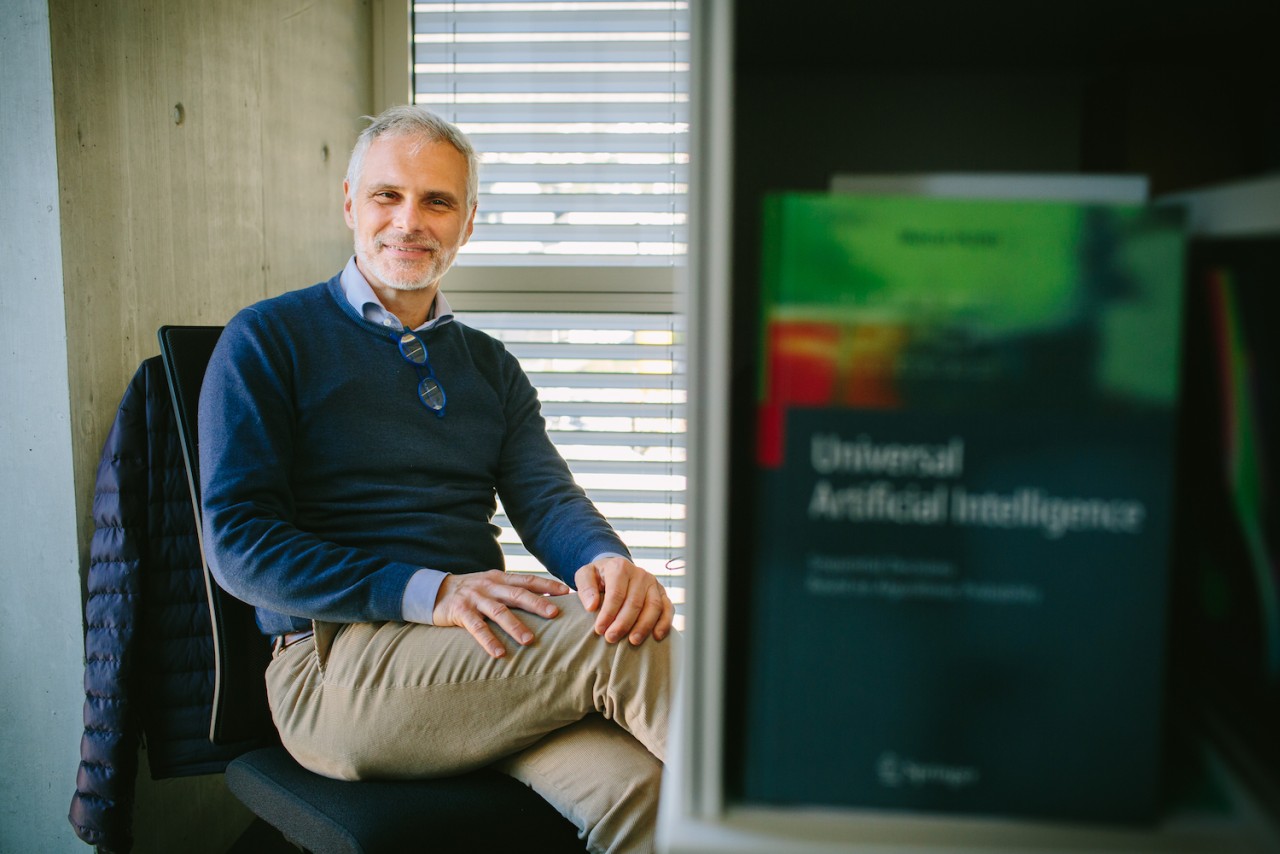

Andrea Rizzoli, responsabile dell’IDSIA USI-SUPSI, ha codiretto, insieme alla polacca Anna Fabijańska, il rapporto alla base delle linee guida per la vicepresidente della Commissione Europea, Margrethe Vestagerdi Simone Pengue

L’intelligenza artificiale chiama e l’Europa risponde. Per poter cogliere i migliori frutti di questa tecnologia informatica e, allo stesso tempo, mitigarne i rischi, l’Unione Europea è intenzionata a istituire un grande istituto di ricerca ad hoc. A dirlo è stata niente meno che la presidente della Commissione Europea Ursula Von der Leyen durante il discorso tenuto in occasione della sua rielezione il 18 luglio: «In questo spirito, proporrò di istituire un Consiglio Europeo per la Ricerca sull’Intelligenza Artificiale, dove possiamo mettere in comune tutte le nostre risorse, simile all’approccio adottato con il CERN». Dietro a questa volontà c’è anche il lavoro del direttore dell’Istituto Dalle Molle di Studi sull’intelligenza artificiale IDSIA USI-SUPSI di Lugano, Andrea Emilio Rizzoli, che, assieme alla professoressa Anna Fabijańska della Lodz University of Technology (Polonia), ha co-diretto la stesura di un rapporto che analizza lo stato attuale e le potenzialità dell’impiego della intelligenza artificiale nella ricerca scientifica (un rapporto che ha coinvolto 35 esperti di tutta Europa e oltre).

Sulla base di questo documento, il gruppo di consulenti scientifici della Commissione Europea, guidato dalla professoressa Nicole Grobert (Oxford), ha definito una serie di raccomandazioni e di linee guida che sono state trasmesse alla vicepresidente esecutiva della Commissione, Margrethe Vestager, durante un incontro tenutosi a Bruxelles il 15 aprile. Tra le raccomandazioni spicca, appunto, la creazione di un istituto comune specializzato nell’íntelligenza artificiale per la ricerca scientifica, al quale auspicabilmente anche la Svizzera dovrebbe poter partecipare. Inoltre, il rapporto contiene importanti raccomandazioni circa l’accesso equo per tutti i ricercatori a dati di buona qualità, raccolti in modo responsabile e trasparente, nonché sulla tutela dei diritti umani e sulla salvaguardia del benessere comune, sostenendo dunque la ricerca anche in ambito legale, economico e filosofico. Ne parliamo con Andrea Emilio Rizzoli.

Perché costituire questo nuovo istituto europeo sull’intelligenza artificiale?

«Il vantaggio - spiega Rizzoli - risiede nel fatto che con una direzione comune è possibile coordinarsi meglio nella gestione dei progetti di ricerca, e si possono attirare finanziamenti importanti, permettendo alle università di fare ricerca di impatto e di portarsi al livello delle grandi aziende del settore».

Come se lo immagina?

«Questa in realtà non è una domanda da fare a me, perché io nel mio ruolo ho esaminato i presupposti che indicano la necessità di avere un Istituto europeo di intelligenza artificiale basandomi sulle pubblicazioni e sui dati disponibili. Sono emerse due alternative: un istituto centralizzato, o un istituto distribuito, e noi non abbiamo preso una posizione, mentre sono stati i consulenti scientifici della Commissione a propendere per la versione dell’istituto distribuito».

Ma la sua opinione personale da “privato cittadino” qual è?

«Io non vedo la necessità di avere un’infrastruttura comune centrale, come può essere il CERN. Esiste già un insieme di laboratori e infrastrutture distribuite a livello europeo che sono istituti di eccellenza, e quindi si deve rafforzare questa rete. Potrebbe essere una buona idea, comunque, creare una specie di punto di incontro, dove magari scienziati e ricercatori passano del tempo assieme, trascorrendo dei periodi di studio o di scambio, ma mantenendo comunque la loro autonomia e indipendenza. È un approccio, diciamo, un po’ federale. Secondo me darebbe alla Svizzera l’opportunità di collaborare anche in una situazione come quella attuale, dove non siamo membri a pieno titolo dei diversi programmi di ricerca dell’Unione Europea. Vedrei la posizione svizzera molto più difficile se, invece, l’istituto europeo fosse centralizzato».

Come è nata l’idea di questo rapporto sull’intelligenza artificiale?

«La vicepresidente esecutiva della Commissione Europea, Margrethe Vestager, aveva chiesto alla SAM (Scientific Advice Mechanism, in italiano meccanismo di consiglio scientifico) - una rete di accademie europee che fornisce consulenza scientifica alla Commissione europea sui temi più dibattuti ed attuali - come avrebbe potuto l’Europa facilitare l’adozione dell’intelligenza artificiale per promuovere e far avanzare la ricerca scientifica. Per rispondere adeguatamente a questa domanda, si sono cercati esperti in tutta Europa e anche in altri continenti. In Svizzera, l’Accademia delle scienze tecniche SATW ha proposto il mio nome, e poi la SAM mi ha scelto come co-presidente del gruppo di lavoro».

Come avete condotto l’indagine?

«Abbiamo lavorato con moltissimi esperti, organizzando quattro convegni nel periodo tra ottobre 2023 e febbraio 2024. Attraverso questi incontri abbiamo esaminato i diversi aspetti dell’impatto dell’intelligenza artificiale sulla ricerca stessa. Quindi, abbiamo valutato in che modo sarebbe stato possibile utilizzarla per risolvere alcuni problemi della ricerca, considerando anche come era stata utilizzata in passato, e come i ricercatori potessero essere facilitati, aiutati o messi anche in difficoltà dall’intelligenza artificiale. Abbiamo poi analizzato il potenziale impatto sulla società e infine abbiamo tratto un ventaglio di possibili opzioni per guidare le scelte politiche che verranno».

Come mai la Svizzera ha fatto parte di questa operazione europea?

«Perché la Svizzera fa parte di questo network di accademie delle scienze a livello europeo. Però mi ha sorpreso, in effetti, l’essere stato scelto con un ruolo di rilievo all’interno del gruppo di lavoro».

Dal punto di vista della collaborazione scientifica, in verità, non è il momento migliore tra Europa e Svizzera. I ricercatori svizzeri non possono più accedere a pieno titolo al programma di finanziamento Horizon.

«Una cosa è la politica, una cosa è la scienza, nel senso che la collaborazione con i Paesi europei nella ricerca non è mai stata sospesa. Il programma Horizon, invece, viene usato dall’Unione europea un po’ come bastone o carota per fare progressi sugli accordi bilaterali. Quindi penso che vada distinto proprio l’aspetto politico da quello invece concreto ed esecutivo».

In marzo l’Unione Europea ha promulgato l’AI Act, un’importante legge sull’intelligenza artificiale, che dal 1° agosto regola soprattutto l’accesso ai dati. Non tutti, però, la vedono di buon occhio. Lei cosa ne pensa?

«Io sono sostanzialmente a favore di una regolamentazione degli abusi dell’intelligenza artificiale e delle manipolazioni che vengono eseguite su questi dati. Alcuni temono che l’AI Act possa impedire lo sviluppo tecnologico, ma in realtà nel campo della ricerca questa legge mette pochissimi limiti. Alcune critiche ben fondate si chiedono, invece, chi effettuerà i controlli, ed effettivamente questo è sempre un problema».

E la Svizzera?

«La Svizzera dovrebbe adottare il regolamento e realisticamente lo farà, perché altrimenti le aziende svizzere di informatica non potrebbero vendere i loro prodotti in Europa. Lo stesso vale per le grosse aziende come Google e Meta, se vogliono accedere al mercato europeo».

L’AI Act ci ricorda che, accanto a un grande potenziale scientifico, ci sono anche dei grandi rischi, che vanno affrontati anche attraverso strumenti di ricerca filosofica, come voi avete suggerito alla Commissione europea. Quali sono le priorità in questo senso?

«Uno degli aspetti su cui si insiste particolarmente è la capacità di giustificazione da parte degli algoritmi dei risultati prodotti, quindi la capacità di ragionare. Attualmente questa è una proprietà emergente, nel senso che sembra apparire, ma non vi è la certezza che ci sia veramente. In particolare, l’algoritmo sembra non riuscire a ragionare in maniera controfattuale: che cosa sarebbe successo se non avessi fatto questo? È una capacità che diventa essenziale nel momento in cui si utilizza l’algoritmo come supporto per prendere decisioni in situazioni critiche. Quindi questo è sicuramente un problema importante da mettere sul tavolo».

Da quale angolazione rappresenta un problema?

«Il rischio principale, nel quale, per così dire, siamo già dentro fino al collo, è quello di affidarci a questi strumenti in maniera acritica, senza tener presente che loro non capiscono quello che stanno facendo. E quindi potrebbero aver tralasciato dei passi importanti, o potrebbero aver mancato alcuni punti fondamentali in una linea di ragionamento. Quindi sarebbe comunque importante un istituto che si occupi non soltanto della parte tecnologica, ma anche della parte etica e delle implicazioni dell’uso dell’intelligenza artificiale sulla società».

Quali sono, invece, i falsi allarmi riguardanti l’intelligenza artificiale?

«Sicuramente - conclude Rizzoli - non è un rischio vero il fatto che le macchine possano diventare super intelligenti e toglierci il controllo delle nostre azioni (insomma, la cosiddetta intelligenza artificiale generale). Per me, questa sarà un’intelligenza diversa dalla nostra, e comunque non è un rischio esistenziale per l’umanità, mentre credo lo sarà il cambiamento climatico».